No cotidiano de qualquer operação de tecnologia, as tarefas repetitivas agem como um dreno silencioso de tempo e orçamento. É o tipo de trabalho que não escala e que desvia o foco da equipe do que realmente importa: inovar e resolver problemas complexos. Durante anos, a resposta para esse desafio esteve em plataformas de automação proprietárias. Elas funcionam, mas têm um efeito colateral incômodo: a conta cresce junto com o seu sucesso. Cada novo fluxo de trabalho ou tarefa executada significa um custo maior, o que muitas vezes força uma escolha difícil entre orçar ou limitar a capacidade de automatizar.

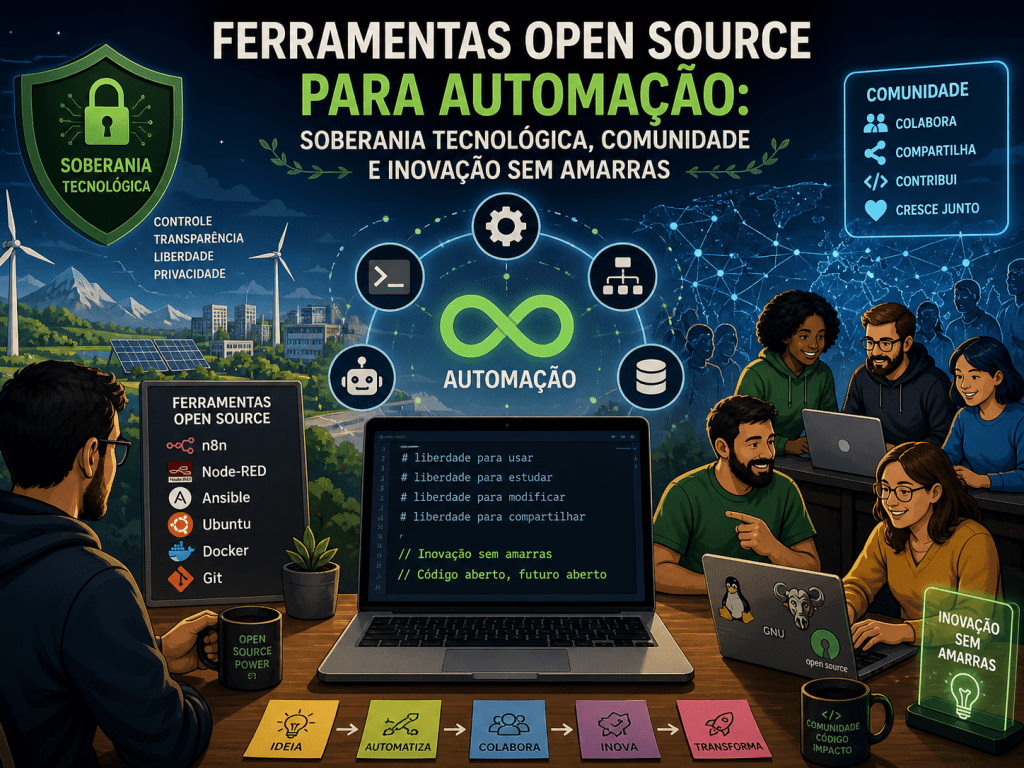

É nesse ponto que as ferramentas open source entram em cena não apenas como uma alternativa, mas como uma mudança de paradigma. Diferente do software proprietário, onde o código é uma caixa-preta controlada por um único fornecedor, o open source tem seu código-fonte disponível publicamente para ser adaptado e redistribuído. Como bem definiu a BIX Tecnologia, o modelo “fomenta colaboração global e acelera a evolução das ferramentas”, garantindo maior acessibilidade e flexibilidade. Em 2026, esse ecossistema amadureceu a ponto de oferecer ferramentas que rivalizam em robustez com qualquer solução paga, cobrindo desde a automação de processos robóticos (RPA) até a orquestração de dados e IA. O objetivo deste texto é mapear esse território: apresentar as principais ferramentas, suas aplicações práticas e como você pode escolher a ideal para destravar a produtividade da sua equipe sem comprometer o orçamento.

Por que Open Source? Os Quatro Pilares da Vantagem Estratégica

A decisão de adotar uma ferramenta open source vai além da gratuidade. Trata-se de uma escolha estratégica apoiada em quatro pilares fundamentais que impactam diretamente a agilidade e a segurança do negócio.

1. Custo-benefício. Esta é a vantagem mais imediata. Ao eliminar as taxas de licenciamento por usuário ou por operação, as empresas podem substituir sistemas proprietários caros por alternativas maduras e robustas. O orçamento que antes era consumido por assinaturas pode ser redirecionado para inovação e capacitação da equipe. Em momentos de expansão, essa vantagem é ainda mais estratégica, já que os custos não crescem na mesma proporção que o uso.

2. Comunidade ativa e inovação coletiva. Um ecossistema vibrante de desenvolvedores, pesquisadores e empresas testa, corrige e aprimora o código continuamente. Isso significa que você não depende de um único fornecedor para corrigir um bug ou implementar uma funcionalidade; a inteligência coletiva da comunidade acelera o processo. O resultado é uma base tecnológica mais estável e com suporte coletivo.

3. Segurança e transparência. Ao contrário do que o senso comum pode sugerir, o open source é frequentemente mais seguro. A transparência do código permite que qualquer pessoa o revise, fazendo com que falhas de segurança sejam descobertas e corrigidas rapidamente. Projetos consolidados, como o Linux, são exemplos de como o escrutínio público contínuo gera sistemas extremamente estáveis e confiáveis.

4. Flexibilidade e soberania tecnológica. Com acesso ao código, as equipes podem adaptar o software às necessidades específicas do negócio e integrá-lo a outras plataformas sem as restrições típicas de um fornecedor. Essa liberdade reduz o risco do vendor lock-in — a dependência de um único fornecedor que pode se tornar um gargalo estratégico. O resultado é um stack tecnológico mais ágil e preparado para mudanças.

Um Ecossistema para Cada Desafio: O Mapa das Ferramentas

Não existe uma única ferramenta que resolva todos os problemas de automação. O ecossistema open source é rico justamente porque se especializou em nichos. A seguir, as categorias e os principais representantes de cada uma.

🧩 Automação de Workflows e Integrações (Low-Code)

Este é o território que substitui ferramentas como Zapier e Make, conectando aplicativos para criar fluxos de trabalho automatizados. O destaque incontestável aqui é o n8n, que lidera com folga ao oferecer uma interface visual de drag-and-drop com a potência de código quando necessário. É possível injetar JavaScript ou Python para lidar com cenários complexos, como cadeias de raciocínio de IA ou consultas avançadas a APIs. Com 181 mil estrelas no GitHub — mais do que todos os concorrentes diretos somados — e mais de 400 integrações nativas, o n8n é a escolha mais segura para a maioria dos negócios, com uma comunidade extremamente ativa.

Outra ferramenta que vem ganhando espaço rapidamente é o Windmill. Ao permitir a criação de workflows e dashboards internos usando Python ou TypeScript, ele se destaca pelo desempenho: chega a ser 13 vezes mais rápido que o Apache Airflow na execução de tarefas. Para equipes de desenvolvimento que precisam de uma alternativa moderna ao Retool para construir aplicações internas, o Windmill é uma escolha certeira.

Para quem está começando e não tem familiaridade com código, o Activepieces surge como a opção mais amigável. Com uma interface limpa e intuitiva, ele oferece integração com cerca de 400 servidores MCP (Model Context Protocol), o que o torna particularmente interessante para cenários que envolvem agentes de IA. Já o veterano Huginn, com mais de uma década de existência e 49 mil estrelas no GitHub, continua sendo uma escolha sólida para tarefas de monitoramento e automação que exigem máxima estabilidade.

⚙️ Orquestração de Dados e Pipelines

Quando o desafio é gerenciar pipelines de dados complexos, com dependências, monitoramento e tolerância a falhas, entramos no mundo dos orquestradores. O Apache Airflow, criado pelo Airbnb, é o veterano da categoria. Ele introduziu o conceito de DAGs (Directed Acyclic Graphs) como código e, desde então, construiu uma comunidade madura, uma interface rica em funcionalidades e um ecossistema com centenas de integrações. Apesar da curva de aprendizado íngreme e da complexidade operacional — exige a configuração de múltiplos serviços como Scheduler e Webserver —, o Airflow continua sendo a escolha natural para cenários enterprise que já possuem infraestrutura e conhecimento estabelecidos.

A nova geração é representada pelo Prefect, que adota uma filosofia centrada em Python. Em vez de exigir um vocabulário próprio de configuração, o Prefect permite que você escreva fluxos como funções Python comuns, usando decoradores como @task e @flow. Isso reduz drasticamente a barreira de entrada, facilita o teste local e promove a modularidade do código. Sua engine é totalmente open source, com uma interface moderna que oferece logging rico e métricas de saúde dos workflows sem a complexidade operacional do Airflow.

Há ainda o ascendente Kestra, que se diferencia por ser uma plataforma declarativa que unifica dados, IA e infraestrutura em um só lugar. Com suporte a múltiplas linguagens (Python, Bash, Node.js, Go) e mais de 1.300 plugins, o Kestra evita a necessidade de código de cola entre sistemas. Em 2025, executou mais de 2 bilhões de workflows, um crescimento de 20 vezes em relação ao ano anterior, sinalizando uma adoção em escala empresarial.

🤖 RPA: Automatizando a Interface

A Automação Robótica de Processos é o domínio em que robôs de software imitam as ações humanas na interface do computador — clicando, digitando e copiando dados entre sistemas. No mundo open source, duas ferramentas se destacam.

O Robot Framework é a escolha de nível empresarial. Com mais de 11 mil estrelas no GitHub e licença Apache 2.0, ele utiliza uma sintaxe baseada em palavras-chave que é acessível tanto para desenvolvedores quanto para analistas de negócio. Sua estrutura modular permite a extensão com bibliotecas Python personalizadas e se integra bem com ferramentas de CI/CD, sendo ideal para automações de processos corporativos que exigem documentação e manutenção de longo prazo.

Para cenários que envolvem interação direta com o navegador web, o Ui.Vision oferece uma abordagem mais visual e multiplataforma. Disponível como extensão para Chrome, Edge e Firefox — e compatível com Windows, macOS e Linux —, ele inclui um gravador de macros web e comandos de visão computacional que permitem automatizar tarefas mesmo quando os elementos da interface são dinâmicos. Isso é especialmente útil para web scraping, extração de dados e automação de sistemas legados que não possuem APIs.

🧪 Automação de Testes

Garantir a qualidade do software sem testes automatizados é como construir uma casa sem alicerces. O trio Selenium, Playwright e Cypress domina o cenário open source de testes de interface web, cada um com filosofias distintas.

O Selenium é o veterano indiscutível. Seu protocolo W3C padronizado e o suporte a múltiplas linguagens (Java, C#, Python, Ruby) o tornam a escolha natural para equipes que mantêm grandes suítes de teste legadas ou que precisam dar suporte a navegadores antigos como o Internet Explorer 11 — algo ainda crítico em setores como o financeiro e governamental. O Playwright, mantido pela Microsoft, representa a abordagem moderna: comunicação via WebSocket com latência inferior a 200ms, espera inteligente de elementos e gravação de traces que permitem depurar falhas em minutos. Para novos projetos que testam aplicações de página única (SPAs), é a recomendação padrão. Já o Cypress se destaca pelo foco radical na experiência do desenvolvedor front-end: por rodar dentro do próprio navegador, oferece um debugging superior, mas sua limitação ao ecossistema Chromium o torna menos adequado para testes cross-browser completos.

🧠 Automação com Inteligência Artificial

A convergência entre automação e IA é a tendência mais marcante de 2026. Ferramentas como LangChain e CrewAI estão na vanguarda da orquestração de agentes inteligentes. O LangChain, com mais de 100 mil estrelas no GitHub, oferece uma arquitetura modular que conecta modelos de linguagem, fontes de dados e ferramentas externas em cadeias de raciocínio, permitindo desde simples chatbots até sistemas complexos de agentes autônomos.

Nesse contexto, o n8n se destaca novamente por seu suporte nativo ao LangChain, permitindo que você incorpore agentes de IA diretamente em fluxos de trabalho de negócios — como um assistente que resume automaticamente e-mails e cria tickets no seu sistema de gestão. Plataformas emergentes como o Kestra também abraçaram essa integração, oferecendo pipelines específicos para cenários de RAG (Geração Aumentada por Recuperação), avaliação de modelos e publicação contínua de agentes de IA com governança e observabilidade.

🏠 Automação Residencial e Pessoal

Saindo do ambiente corporativo, o open source também lidera o movimento de casas inteligentes que respeitam a privacidade. Home Assistant e openHAB são os dois pilares dessa categoria. O Home Assistant prioriza a privacidade e o controle local, armazenando dados no seu hardware em vez da nuvem e oferecendo uma interface moderna que funciona perfeitamente no desktop e no celular. Suporta mais de mil marcas e protocolos como Zigbee, Matter e Z-Wave, sendo impulsionado por uma comunidade global extremamente ativa.

O openHAB, por sua vez, brilha na compatibilidade máxima, conectando-se perfeitamente com mais de 2.000 dispositivos de fabricantes como Samsung, LG e Philips. Sua engine de regras permite criar automações sofisticadas — como dimerizar luzes ao anoitecer ou ajustar o termostato quando você sai de casa — com uma lógica visual intuitiva.

🏗️ Automação de Infraestrutura (IaC)

Para equipes de DevOps, a automação da infraestrutura é a base sobre a qual tudo funciona. Terraform e Ansible são as ferramentas open source que dominam esse espaço. O Terraform, da HashiCorp, é a escolha para provisionamento: ele define o que deve existir na sua infraestrutura de nuvem — máquinas virtuais, bancos de dados, redes — e gerencia o ciclo de vida desses recursos através de um arquivo de estado, garantindo que a realidade sempre reflita o código.

O Ansible, mantido pela Red Hat, atua na camada de configuração: ele define como esses recursos devem ser configurados — instalando pacotes, gerenciando serviços, aplicando políticas de segurança. É comum que as duas ferramentas operem em conjunto: o Terraform provisiona os servidores e o Ansible os configura e mantém. O Kestra, mencionado anteriormente, também pode orquestrar execuções de Terraform e Ansible, unificando o gerenciamento de toda a stack sob um único motor de workflows com governança.

Como Escolher a Ferramenta Certa: Um Guia em Quatro Passos

Com tamanha variedade, a decisão pode parecer paralisante. Um processo estruturado em quatro perguntas ajuda a navegar por esse ecossistema:

1. Qual problema você realmente está resolvendo? Seja específico. Conectar aplicativos SaaS e automatizar processos de negócio aponta para n8n ou Activepieces. Gerenciar pipelines de dados complexos com dependências indica Airflow, Prefect ou Kestra. Testar uma aplicação web moderna sugere Playwright; testar um sistema legado que ainda funciona no IE11, Selenium. Automatizar tarefas repetitivas na interface do usuário remete ao Robot Framework ou Ui.Vision. A clareza sobre o problema é o filtro mais importante.

2. Qual o nível de maturidade técnica da sua equipe? Algumas ferramentas exigem conhecimento profundo de Python e conceitos de orquestração (Prefect, Kestra), enquanto outras são acessíveis a usuários de negócio que nunca escreveram uma linha de código (Activepieces, interface drag-and-drop do n8n para cenários simples). O custo de aprendizado e manutenção deve ser considerado no cálculo do ROI.

3. Quais integrações são necessárias? Uma ferramenta pode ser excelente, mas se ela não se conecta com o seu CRM, ERP ou banco de dados, a adoção será frustrante. Verifique se existem conectores nativos — o n8n oferece mais de 400, enquanto o Kestra conta com mais de 1.300 plugins — ou se você precisará desenvolvê-los, o que adiciona complexidade ao projeto.

4. Como a ferramenta lida com a comunidade e a saúde do projeto? Projetos open source não são estáticos. Verifique a frequência de commits no GitHub, o número de estrelas como proxy de popularidade, a existência de documentação atualizada e a atividade nos fóruns da comunidade. O n8n lidera com 181 mil estrelas, mas projetos menores como o Automatisch podem ter um futuro incerto por conta de licenciamento não definido, o que pode representar um risco de descontinuidade.

Conclusão: O Futuro é Aberto, Distribuído e Inteligente

O cenário de ferramentas open source para automação em 2026 não é mais uma promessa — é uma realidade madura que já alimenta infraestruturas críticas em escala global. A convergência entre automação tradicional e inteligência artificial generativa, personificada em plataformas como n8n, Kestra e LangChain, está criando um novo patamar de produtividade. A capacidade de orquestrar agentes de IA que raciocinam, acessam dados em tempo real e tomam decisões operacionais não é mais exclusividade de grandes corporações com orçamentos milionários. Ela está disponível para qualquer equipe disposta a investir tempo de aprendizado em troca de uma vantagem estratégica duradoura: soberania sobre seus dados, liberdade de seus fluxos de trabalho e independência de fornecedores.

O ecossistema open source não é apenas sobre código aberto — é sobre conhecimento aberto, comunidades colaborativas e a convicção de que as ferramentas mais poderosas devem estar ao alcance de todos. Como afirma a Red Hat, “o open source é essencial ao futuro da IA” justamente porque democratiza o acesso à inovação e acelera o progresso tecnológico de forma compartilhada. Seja você um desenvolvedor solitário automatizando tarefas pessoais, uma startup buscando escalar sem explodir custos, ou uma grande empresa orquestrando milhares de pipelines de dados, há um ecossistema vibrante pronto para ser explorado — e a melhor hora para começar é agora.